La tecnología siempre ha sido sinónimo de poder. En la antigüedad, el hierro podía al bronce, y en la edad moderna la pólvora al hierro. En casa, manda quien tiene el mando, en el trabajo, quien tiene la clave del wifi y en el mundo, quien controla los modelos de IA. El fenómeno no es nuevo, la escala sí.

Lo hemos vivido en directo estas últimas dos semanas con el pulso público que han mantenido Anthropic y el Departamento de Guerra de EE.UU. (DoW). Anthropic no permite que su modelo Claude se utilice para tareas de vigilancia masiva ni para controlar armas autónomas letales. Dario Amodei, su consejero delegado, ha recibido presiones por tierra, mar y Twitter del Ejecutivo de Trump para que eliminase estas restricciones del contrato. En caso contrario, el DoW no solo les rescindirá

el contrato de 200 millones de dólares, sino que Anthropic sería designada como riesgo para la cadena de suministro; ningún proveedor del ejército podría utilizar los modelos de Anthropic. Pese a todo, Dario Amodei se ha mantenido firme.

Anthropic fue fundada en el 2021 por Amodei y seis extrabajadores más de OpenAI. Se marcharon por discrepancias con Sam Altman en aspectos éticos y morales. Para evitar caer en los mismos errores, se propusieron que la suya fuera una IA

entrenada siguiendo un conjunto de principios éticos, una “constitución” que guía su comportamiento. Inspirada inicialmente en fuentes como la Declaración Universal de los Derechos Humanos, los términos de servicio de Apple (estos me hacen mucha gracia) o los principios de seguridad propuestos por otros laboratorios, establece las normas que el modelo utiliza para autocriticarse y revisar sus respuestas. La versión actual de la “constitución” es un documento de 84 páginas filosóficamente muy profundo.

La IA constitucional resiste ante el Departamento de Guerra de EE.UU.

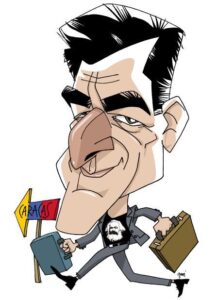

Sabiendo esto, se entiende que Dario Amodei no cediera al chantaje de los matones de Trump, sencillamente porque, aparte de su ética, su modelo constitucional no se lo permite. Esta constitucionalidad –manera ética de funcionar– ha sido tachada tanto por Donald Trump como por Pete Hegseth de “IA woke ”. En su post de bilis por la decisión de Amodei, con la prosa habitual de niño malcriado de seis años, Trump tachaba a Anthropic de “empresa woke de izquierda radical fuera de control”, y a sus trabajadores, de “desequilibrados”.

Ni que decir tiene que OpenAI, con Sam Altman a la cabeza, ha corrido a ocupar el lugar de Anthropic firmando un acuerdo con el DoW. Altman ha tuiteado que OpenAI tampoco permite el uso de sus modelos para vigilancia masiva ni para el control de armas letales autónomas. Algo no cuadra.

En todo caso, la predisposición de OpenAI a trabajar con el DoW estadounidense da la razón al Dario Amodei del 2021, el que se marchó de OpenAI por razones éticas y morales. Esta guerra es la mejor prueba de que desde entonces hemos errado el foco buscando ética y moralidad en la IA: lo que deberíamos haber hecho era buscarla entre sus impulsores. El fenómeno no es nuevo, la escala sí.